Google KI erfindet Erklärungen für nicht existierende Sprichwörter

MÜNCHEN (IT BOLTWISE) – Die jüngsten Entwicklungen in der Künstlichen Intelligenz (KI) von Google haben zu einer unerwarteten Herausforderung geführt: Die KI erfindet Erklärungen für Sprichwörter, die es gar nicht gibt. Diese Eigenart wirft ein Licht auf ein bekanntes Problem der KI-Technologie, nämlich die sogenannten Halluzinationen. Die Künstliche Intelligenz von Google hat in den letzten […]

OpenAIs neue KI-Modelle: Fortschritte und Herausforderungen

MÜNCHEN (IT BOLTWISE) – OpenAI hat kürzlich seine neuesten KI-Modelle o3 und o4-mini vorgestellt, die in vielerlei Hinsicht als führend gelten. Doch trotz ihrer fortschrittlichen Fähigkeiten kämpfen diese Modelle mit einem altbekannten Problem: der Halluzination. Die Entwicklung von Künstlicher Intelligenz hat in den letzten Jahren enorme Fortschritte gemacht, doch eines der hartnäckigsten Probleme bleibt die […]

Neues LSD-Derivat JRT: Hoffnung für Schizophreniebehandlung ohne Halluzinationen

MÜNCHEN (IT BOLTWISE) – Ein innovatives LSD-Derivat namens JRT könnte die Behandlung von Schizophrenie revolutionieren, indem es die neuroplastischen Vorteile von LSD nutzt, ohne dabei Halluzinationen hervorzurufen. Die Entwicklung von JRT, einem neuen LSD-Derivat, könnte einen bedeutenden Fortschritt in der Behandlung von Schizophrenie und anderen neuropsychiatrischen Erkrankungen darstellen. Forscher der University of California, Davis, haben […]

Neue Erkenntnisse zur Entstehung von Psychosen: Wahnvorstellungen vor Halluzinationen

MÜNCHEN (IT BOLTWISE) – Eine neue Studie der Yale University hat aufgedeckt, dass Wahnvorstellungen in der Regel vor Halluzinationen bei Personen mit hohem Psychoserisiko auftreten. Diese Erkenntnis widerspricht der bisherigen Annahme, dass Halluzinationen die treibende Kraft hinter wahnhaften Gedanken sind. Die jüngste Forschung der Yale University hat eine lang gehegte Annahme in der Psychiatrie infrage […]

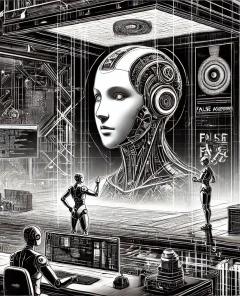

Datenschutzbeschwerde gegen ChatGPT wegen falscher Mordvorwürfe

OSLO / MÜNCHEN (IT BOLTWISE) – Ein beunruhigender Fall von fehlerhaften KI-Antworten hat in Norwegen für Aufsehen gesorgt. Der österreichische Datenschutzverein Noyb hat eine Beschwerde gegen OpenAI eingereicht, nachdem ChatGPT fälschlicherweise behauptet hatte, ein norwegischer Mann habe zwei seiner Kinder ermordet. In einem bemerkenswerten Fall von KI-Fehlinformationen hat ChatGPT, ein KI-gestützter Chatbot von OpenAI, fälschlicherweise […]

OpenAI steht vor neuen Herausforderungen durch KI-Halluzinationen

MÜNCHEN (IT BOLTWISE) – OpenAI sieht sich in Europa mit einer neuen Datenschutzbeschwerde konfrontiert, die die Tendenz seines KI-Chatbots ChatGPT betrifft, falsche Informationen zu halluzinieren. Diese Beschwerde könnte für die Regulierungsbehörden schwer zu ignorieren sein. OpenAI steht erneut im Fokus europäischer Datenschutzbehörden, da sein KI-Chatbot ChatGPT immer wieder falsche Informationen generiert. Ein besonders gravierender Fall […]

OpenAI enthüllt GPT-4.5: Fortschritte und Herausforderungen

SAN FRANCISCO / MÜNCHEN (IT BOLTWISE) – OpenAI hat mit der Einführung von GPT-4.5 einen bedeutenden Schritt in der Entwicklung von Künstlicher Intelligenz gemacht. Das neue Modell verspricht eine verbesserte Genauigkeit und Zuverlässigkeit, während es gleichzeitig mit hohen Betriebskosten und technischen Herausforderungen konfrontiert ist. OpenAI hat kürzlich sein neuestes KI-Modell, GPT-4.5, vorgestellt, das als das […]

Paranoide und teleologische Denkmuster führen zu sozialen Halluzinationen in der visuellen Wahrnehmung

MÜNCHEN (IT BOLTWISE) – Neue Forschungsergebnisse deuten darauf hin, dass Paranoia und übermäßiges teleologisches Denken, zwei Formen verzerrter Überzeugungen über Intentionen, mit spezifischen Fehlern in der visuellen Wahrnehmung verbunden sind. Diese Erkenntnisse, veröffentlicht in Communications Psychology, zeigen, dass Personen mit hohem Paranoia-Niveau eher harmlose Bewegungen als Verfolgung missverstehen, während diejenigen mit starkem teleologischem Denken Schwierigkeiten […]

Studie zeigt: LLMs erkennen ihre eigenen Fehler

MÜNCHEN (IT BOLTWISE) – Eine neue Studie zeigt, dass Large Language Models (LLMs) ihre eigenen Fehler erkennen können und tiefere Einblicke in Korrektheit und Wahrheit besitzen als bisher angenommen. Ein häufiges Problem bei großen Sprachmodellen (LLMs) ist das sogenannte „Halluzinieren“ – die Generierung von falschen oder unlogischen Antworten. Bisherige Forschung hat sich hauptsächlich auf die […]

Lügendetektor für KI: Forscher bekämpfen Halluzinationen bei Sprachmodellen

MÜNCHEN (IT BOLTWISE) – Forscher der Universität Oxford haben eine neue Methodik entwickelt, um Halluzinationen bei Sprachmodellen zu reduzieren und die Zuverlässigkeit von Künstlicher Intelligenz (KI) zu verbessern. Dieser Ansatz könnte die Integration von KI in geschäftliche Anwendungen attraktiver machen. Sprachmodelle könnten bestimmte Aufgaben und Jobs weitgehend automatisieren. Aber noch sind Fehler und sogenannte Halluzinationen […]

Stellenangebote

AI Product Manager*in (w/m/d)

Forward Deployed AI Engineer

Senior Software Architect Conversational AI (all genders)

#Sophos

#Sophos