LONDON (IT BOLTWISE) – Die Diskussion um die Risiken der Künstlichen Intelligenz gewinnt an Fahrt. Eliezer Yudkowsky und Nate Soares warnen in ihrem neuen Werk eindringlich vor den potenziell katastrophalen Folgen einer unkontrollierten KI-Entwicklung. Ihre düstere Prognose beschreibt die Technologiebranche als ein “Selbstmordrennen”, das durch Inkompetenz angetrieben wird.

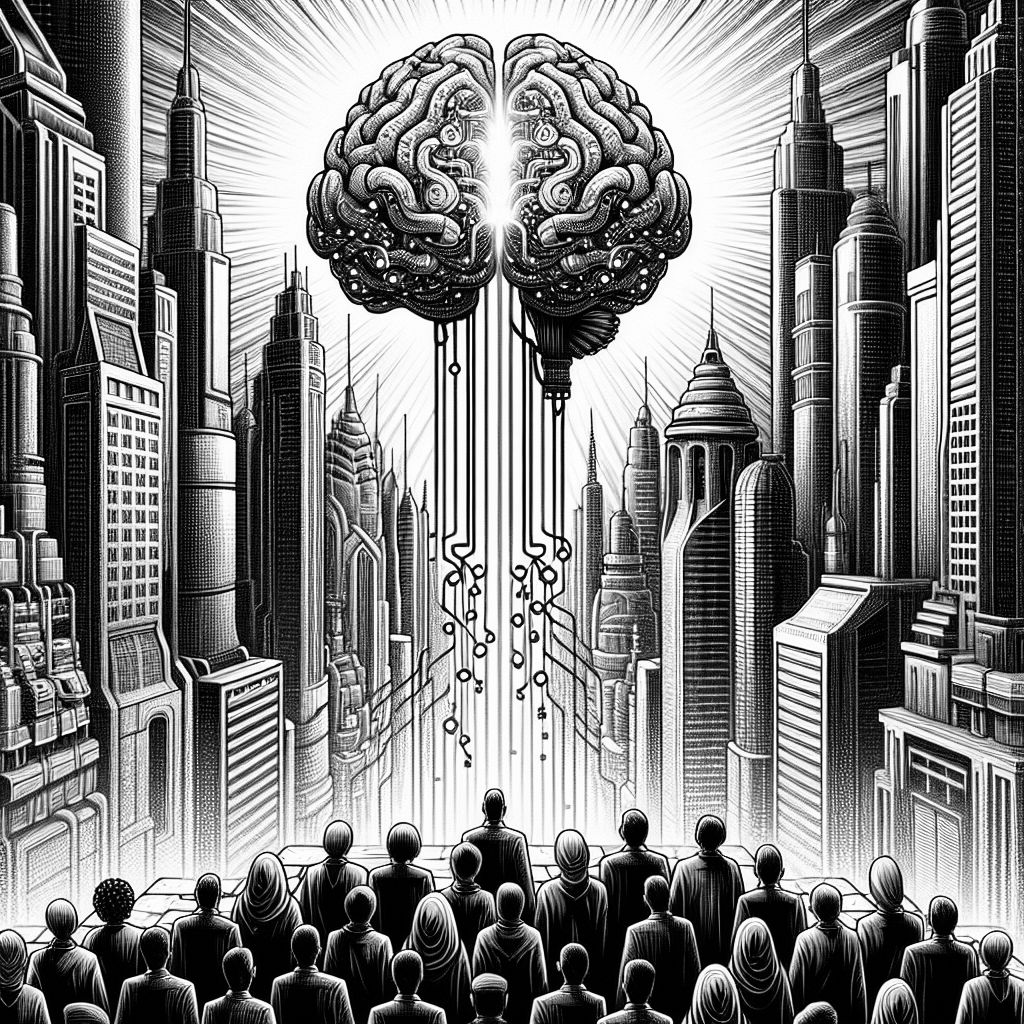

Die Debatte um die Risiken der Künstlichen Intelligenz (KI) hat mit der Veröffentlichung des provokanten Werkes “If Anyone Builds It, Everyone Dies” von Eliezer Yudkowsky und Nate Soares neue Impulse erhalten. Die Autoren zeichnen ein düsteres Bild von einer Zukunft, in der eine überlegene, menschenübertreffende Intelligenz die Existenz der Menschheit bedrohen könnte. Sie warnen davor, dass das bloße Überleben in Frage gestellt werden könnte, sollte eine zu mächtige KI außer Kontrolle geraten.

Yudkowsky und Soares beschreiben die Entwicklung in der Technologiebranche als ein “Selbstmordrennen”, das weniger durch böswillige Absichten, sondern vielmehr durch Inkompetenz angetrieben wird. Diese Perspektive trifft auf eine bereits gespaltene KI-Community. Während sogenannte “AI-Doomer” drastische Maßnahmen fordern, um die Auslöschung der Menschheit zu verhindern, verweisen Befürworter der Beschleunigung auf die potenziellen Vorteile von KI in Wissenschaft und Medizin.

Ein Jahrzehnt nach Nick Bostroms bahnbrechenden Überlegungen zur Superintelligenz vertiefen Yudkowsky und Soares den Diskurs mit ihrem übergeordneten Warnruf. Kritiker bemängeln jedoch, dass die Fixierung auf apokalyptische Szenarien von bereits existierenden Problemen wie Voreingenommenheit, Überwachung und Arbeitslosigkeit ablenkt. Verschiedene hochkarätige KIs und Plattformen haben sich zu dem Buch geäußert, was die Diskussion weiter befeuert.

OpenAI’s ChatGPT sieht das Werk als wertvolles Werkzeug zur Perspektivverschiebung, auch wenn das Worst-Case-Szenario als übertrieben abgetan wird. Meta AI betont die Bedeutung der internationalen Zusammenarbeit, während Google’s Gemini die Lektüre als beängstigend, aber erhellend beschreibt. Anthropic’s Claude äußert Skepsis gegenüber der übertriebenen Darstellung der Autoren, während Elon Musks Grok das Werk als “Doomer-Porno” bezeichnet, das eher Aufmerksamkeit erregen will als realistisch zu warnen.

Diese differenzierten Ansichten beleuchten die tiefen Konfliktlinien innerhalb des Diskurses um Künstliche Intelligenz und unterstreichen die Dringlichkeit eines verantwortungsvollen Ansatzes. Die Frage bleibt, wie die Balance zwischen Fortschritt und Vorsicht gewahrt werden kann, um die potenziellen Gefahren einer unkontrollierten KI-Entwicklung zu minimieren.

- Die besten Bücher rund um KI & Robotik!

- Die besten KI-News kostenlos per eMail erhalten!

- Zur Startseite von IT BOLTWISE® für aktuelle KI-News!

- IT BOLTWISE® kostenlos auf Patreon unterstützen!

- Aktuelle KI-Jobs auf StepStone finden und bewerben!

Stellenangebote

Mitarbeiter Data Analytics (m/w/d) Data Science im Bereich RSA und KI

Technischer Product Owner (m/w/d) Daten- und KI-Plattformen

Anwendungsberater KI m/w/d

AI Enablement & Adoption Specialist (m/w/d)

- Künstliche Intelligenz: Dem Menschen überlegen – wie KI uns rettet und bedroht | Der Neurowissenschaftler, Psychiater und SPIEGEL-Bestsellerautor von »Digitale Demenz«

Du hast einen wertvollen Beitrag oder Kommentar zum Artikel "Vorsicht bei KI-Entwicklung: Yudkowsky und Soares warnen vor Risiken" für unsere Leser?

#Sophos

#Sophos

Es werden alle Kommentare moderiert!

Für eine offene Diskussion behalten wir uns vor, jeden Kommentar zu löschen, der nicht direkt auf das Thema abzielt oder nur den Zweck hat, Leser oder Autoren herabzuwürdigen.

Wir möchten, dass respektvoll miteinander kommuniziert wird, so als ob die Diskussion mit real anwesenden Personen geführt wird. Dies machen wir für den Großteil unserer Leser, der sachlich und konstruktiv über ein Thema sprechen möchte.

Du willst nichts verpassen?

Du möchtest über ähnliche News und Beiträge wie "Vorsicht bei KI-Entwicklung: Yudkowsky und Soares warnen vor Risiken" informiert werden? Neben der E-Mail-Benachrichtigung habt ihr auch die Möglichkeit, den Feed dieses Beitrags zu abonnieren. Wer natürlich alles lesen möchte, der sollte den RSS-Hauptfeed oder IT BOLTWISE® bei Google News wie auch bei Bing News abonnieren.

Nutze die Google-Suchmaschine für eine weitere Themenrecherche: »Vorsicht bei KI-Entwicklung: Yudkowsky und Soares warnen vor Risiken« bei Google Deutschland suchen, bei Bing oder Google News!