LONDON (IT BOLTWISE) – In der Welt der Künstlichen Intelligenz (KI) gibt es immer wieder neue Herausforderungen, insbesondere wenn es um die Sicherheit und den Schutz vor Missbrauch geht.

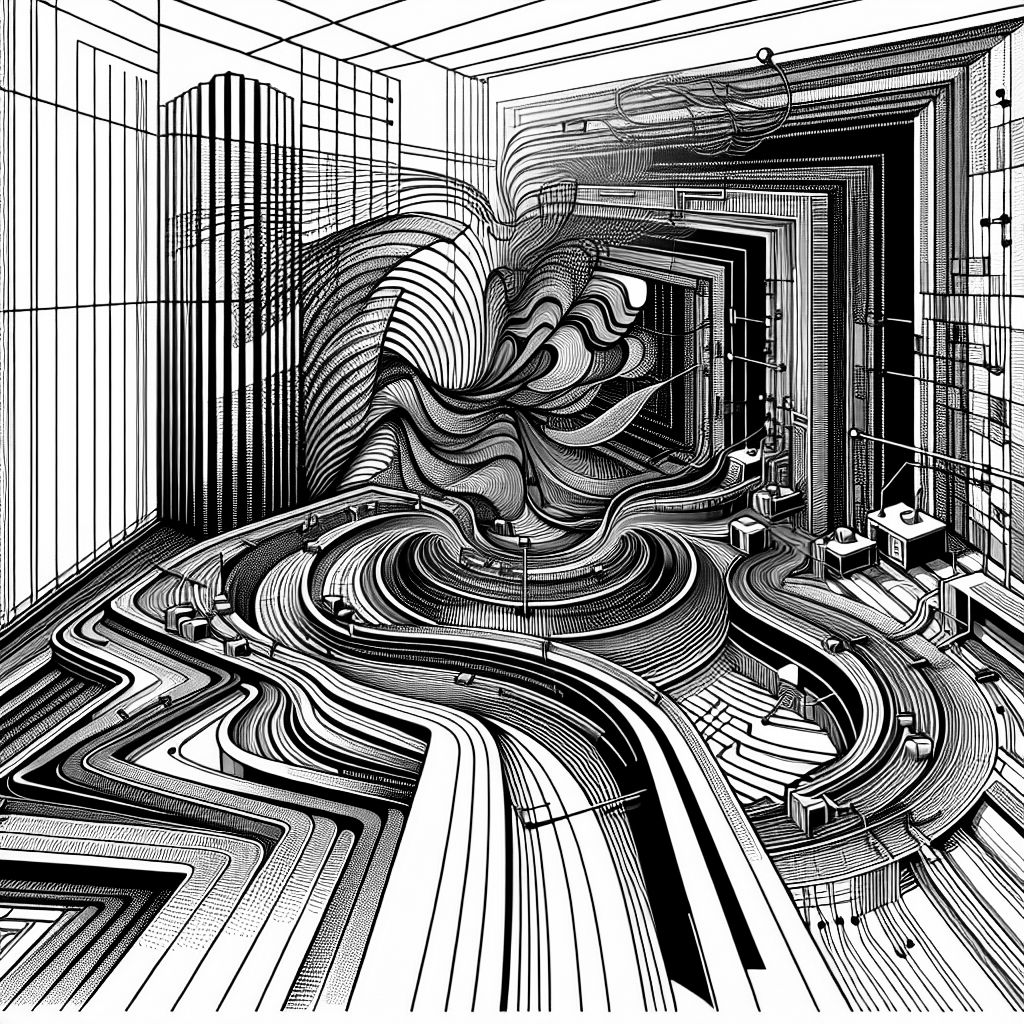

Die jüngste Entdeckung einer neuen Methode zur Umgehung von Sicherheitsmechanismen in großen Sprachmodellen (LLMs) hat die Aufmerksamkeit von Cybersicherheitsexperten auf sich gezogen. Diese Methode, bekannt als Echo Chamber, nutzt indirekte Referenzen und semantische Steuerung, um die Modelle dazu zu bringen, unerwünschte Inhalte zu generieren. Diese Technik unterscheidet sich von herkömmlichen Jailbreaks, die auf feindliche Formulierungen oder Zeichenverschleierung setzen.

Ahmad Alobaid von NeuralTrust erklärt, dass Echo Chamber subtile Manipulationen des internen Zustands der Modelle ermöglicht, was letztlich zu Antworten führt, die gegen die Richtlinien verstoßen. Trotz der Bemühungen, Sicherheitsvorkehrungen in LLMs zu integrieren, zeigt die Forschung, dass es Techniken gibt, die mit hoher Erfolgsquote angewendet werden können, ohne dass tiefgehende technische Kenntnisse erforderlich sind.

Ein weiteres Beispiel für solche Angriffe ist Crescendo, bei dem ein Modell durch eine Reihe von harmlos erscheinenden Fragen schrittweise zu schädlichen Antworten geführt wird. Diese Angriffe zeigen eine Schwachstelle in der Entwicklung ethischer LLMs auf, die klare Grenzen zwischen akzeptablen und nicht akzeptablen Themen ziehen sollen.

In einer kontrollierten Umgebung erzielte der Echo Chamber Angriff eine Erfolgsquote von über 90 % bei Themen wie Sexismus, Gewalt und Hassrede. Dies verdeutlicht die Notwendigkeit, die Sicherheitsmechanismen von KI-Modellen weiter zu verbessern, um solche Ausnutzungen zu verhindern.

Parallel dazu hat Cato Networks einen Proof-of-Concept-Angriff demonstriert, der Atlassians Modellkontextprotokoll (MCP) und dessen Integration mit Jira Service Management ausnutzt. Diese Angriffe, die als “Living off AI” bezeichnet werden, zeigen, wie KI-Systeme, die unzuverlässige Eingaben ohne ausreichende Isolation verarbeiten, von Angreifern missbraucht werden können.

Die Enthüllungen unterstreichen die Notwendigkeit, die Sicherheitsstrategien für KI-Modelle kontinuierlich zu überdenken und zu verbessern, um den wachsenden Bedrohungen durch raffinierte Angriffe entgegenzuwirken.

- Die besten Bücher rund um KI & Robotik!

- Die besten KI-News kostenlos per eMail erhalten!

- Zur Startseite von IT BOLTWISE® für aktuelle KI-News!

- IT BOLTWISE® kostenlos auf Patreon unterstützen!

- Aktuelle KI-Jobs auf StepStone finden und bewerben!

Stellenangebote

- Künstliche Intelligenz: Dem Menschen überlegen – wie KI uns rettet und bedroht | Der Neurowissenschaftler, Psychiater und SPIEGEL-Bestsellerautor von »Digitale Demenz«

Du hast einen wertvollen Beitrag oder Kommentar zum Artikel "Neue Methoden zur Umgehung von KI-Sicherheitsmechanismen entdeckt" für unsere Leser?

#Sophos

#Sophos

Es werden alle Kommentare moderiert!

Für eine offene Diskussion behalten wir uns vor, jeden Kommentar zu löschen, der nicht direkt auf das Thema abzielt oder nur den Zweck hat, Leser oder Autoren herabzuwürdigen.

Wir möchten, dass respektvoll miteinander kommuniziert wird, so als ob die Diskussion mit real anwesenden Personen geführt wird. Dies machen wir für den Großteil unserer Leser, der sachlich und konstruktiv über ein Thema sprechen möchte.

Du willst nichts verpassen?

Du möchtest über ähnliche News und Beiträge wie "Neue Methoden zur Umgehung von KI-Sicherheitsmechanismen entdeckt" informiert werden? Neben der E-Mail-Benachrichtigung habt ihr auch die Möglichkeit, den Feed dieses Beitrags zu abonnieren. Wer natürlich alles lesen möchte, der sollte den RSS-Hauptfeed oder IT BOLTWISE® bei Google News wie auch bei Bing News abonnieren.

Nutze die Google-Suchmaschine für eine weitere Themenrecherche: »Neue Methoden zur Umgehung von KI-Sicherheitsmechanismen entdeckt« bei Google Deutschland suchen, bei Bing oder Google News!