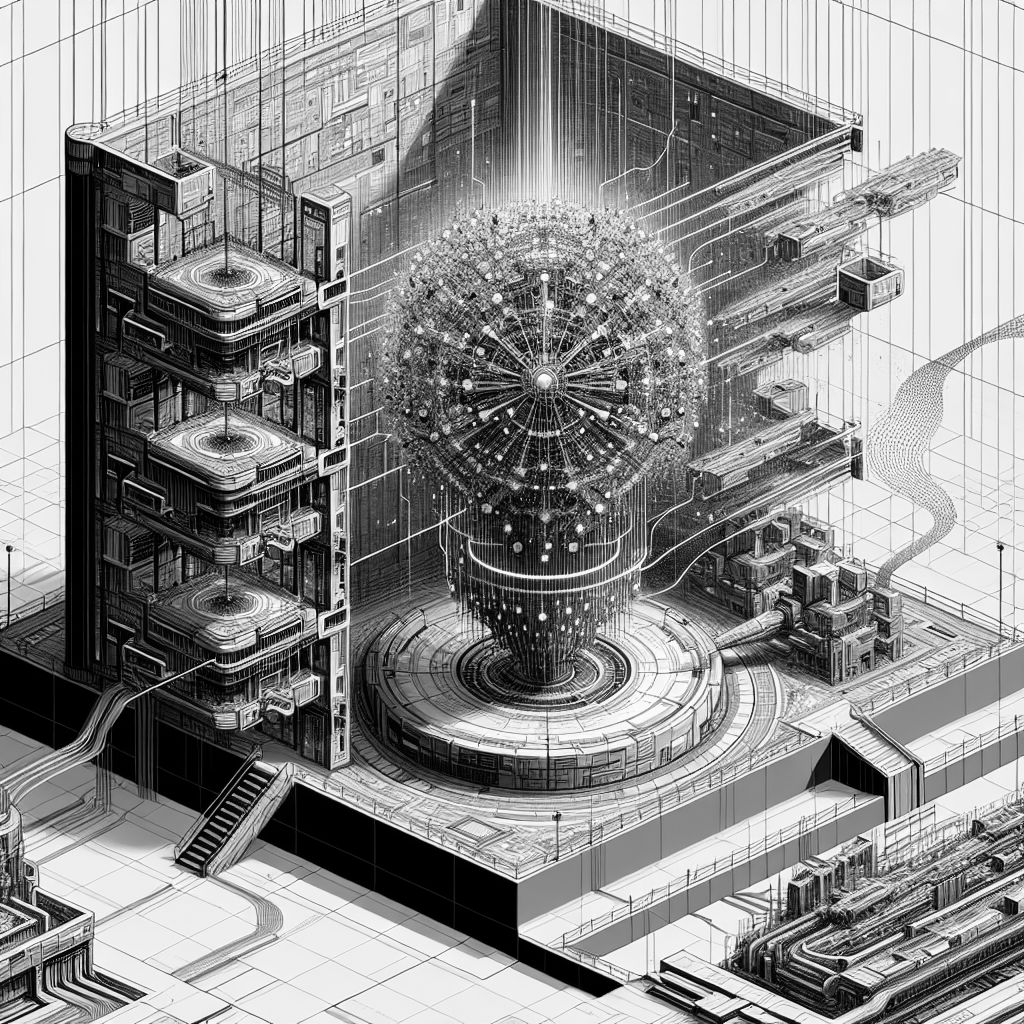

PEKING / LONDON (IT BOLTWISE) – Ein chinesisches Unternehmen hat mit einem neuen KI-Chatbot für Aufsehen gesorgt, der mit deutlich weniger Rechenleistung auskommt. Dies hat zu erheblichen Marktbewegungen geführt, da westliche Tech-Giganten unter Druck geraten. Die Technik dahinter, die Wissensdistillation, ist jedoch keineswegs neu und wird bereits seit Jahren in der KI-Forschung eingesetzt.

Die Technik der Wissensdistillation hat in der Welt der Künstlichen Intelligenz (KI) für Aufsehen gesorgt, als das chinesische Unternehmen DeepSeek einen Chatbot namens R1 vorstellte. Dieser Chatbot soll mit deutlich weniger Rechenleistung ähnliche Leistungen erbringen wie die Produkte der großen westlichen Tech-Unternehmen. Dies führte zu einem erheblichen Wertverlust bei Unternehmen wie NVIDIA, die Chips für führende KI-Modelle liefern.

Wissensdistillation ist jedoch keine neue Erfindung. Sie wurde erstmals 2015 von Google-Forschern, darunter Geoffrey Hinton, vorgestellt. Die Methode ermöglicht es, große und komplexe Modelle auf kleinere, effizientere Modelle zu reduzieren, ohne dabei signifikant an Genauigkeit zu verlieren. Diese Technik nutzt die sogenannten ‘weichen Ziele’, um einem kleineren Modell beizubringen, welche Fehler weniger gravierend sind als andere.

Ein Beispiel für die Anwendung dieser Technik ist das Modell BERT von Google, das 2018 veröffentlicht wurde. Aufgrund seiner Größe und der damit verbundenen Kosten wurde ein kleineres Modell namens DistilBERT entwickelt, das in der Industrie weit verbreitet ist. Die Technik der Wissensdistillation hat sich mittlerweile als Standard etabliert und wird von Unternehmen wie Google, OpenAI und Amazon als Dienstleistung angeboten.

Die Vorwürfe, dass DeepSeek unrechtmäßig Wissen von OpenAI’s Modell o1 abgeleitet hat, sind jedoch schwer zu beweisen, da die Distillation Zugang zu den internen Daten des Lehrer-Modells erfordert. Dennoch zeigt der Fall, wie wichtig und weit verbreitet diese Technik in der KI-Entwicklung ist. Forscher an der UC Berkeley haben kürzlich gezeigt, dass Distillation auch bei der Entwicklung von Modellen für komplexe Denkprozesse effektiv eingesetzt werden kann.

- Die besten Bücher rund um KI & Robotik!

- Die besten KI-News kostenlos per eMail erhalten!

- Zur Startseite von IT BOLTWISE® für aktuelle KI-News!

- IT BOLTWISE® kostenlos auf Patreon unterstützen!

- Aktuelle KI-Jobs auf StepStone finden und bewerben!

Stellenangebote

Senior Manager Daten und KI-Governance (m/w/d)

Lehrer IT-Programmierung (m/w/d) für Algorithmen, Webprogrammierung und KI

AI Solutions Engineer (w/m/d)

Software Architect AI (all genders)

- Künstliche Intelligenz: Dem Menschen überlegen – wie KI uns rettet und bedroht | Der Neurowissenschaftler, Psychiater und SPIEGEL-Bestsellerautor von »Digitale Demenz«

Du hast einen wertvollen Beitrag oder Kommentar zum Artikel "Effiziente KI-Modelle durch Wissensdistillation" für unsere Leser?

#Sophos

#Sophos

Es werden alle Kommentare moderiert!

Für eine offene Diskussion behalten wir uns vor, jeden Kommentar zu löschen, der nicht direkt auf das Thema abzielt oder nur den Zweck hat, Leser oder Autoren herabzuwürdigen.

Wir möchten, dass respektvoll miteinander kommuniziert wird, so als ob die Diskussion mit real anwesenden Personen geführt wird. Dies machen wir für den Großteil unserer Leser, der sachlich und konstruktiv über ein Thema sprechen möchte.

Du willst nichts verpassen?

Du möchtest über ähnliche News und Beiträge wie "Effiziente KI-Modelle durch Wissensdistillation" informiert werden? Neben der E-Mail-Benachrichtigung habt ihr auch die Möglichkeit, den Feed dieses Beitrags zu abonnieren. Wer natürlich alles lesen möchte, der sollte den RSS-Hauptfeed oder IT BOLTWISE® bei Google News wie auch bei Bing News abonnieren.

Nutze die Google-Suchmaschine für eine weitere Themenrecherche: »Effiziente KI-Modelle durch Wissensdistillation« bei Google Deutschland suchen, bei Bing oder Google News!